大家好,我是你们的技术博主枫夜求索阁!

今天要聊一个让AI从"嘴炮王者"变身"学术裁缝"的黑科技——RAG(检索增强生成)。这货堪称人工智能界的"人形自走图书馆",专治模型胡编乱造的老毛病!

今天文末埋了现金红包彩蛋💰

传统AI的翻车现场

想象你家二哈突然开口说话,虽然能对答如流,但满嘴都是:"秦始皇用iPhone直播统一六国"...

🤦♂️ 传统生成模型(如GPT)就像这只知识储备停留在训练数据截止日的二哈,容易产出过时或失实的"狗言狗语"。

RAG的作弊神器原理

RAG=检索(Retrieval)+生成(Generation),操作分两步走:

- 考前突击模式(检索阶段)

- 用户提问 → 模型秒变图书管理员

- 用语义检索在知识库(如维基百科/企业文档)捞取相关段落

- 类似用Ctrl+F搜论文,但更智能(用嵌入向量计算相似度)

- 学术裁缝模式(生成阶段)

- 把检索到的资料+原始问题打包喂给语言模型

- 模型边看参考答案边写小作文,生成最终答案

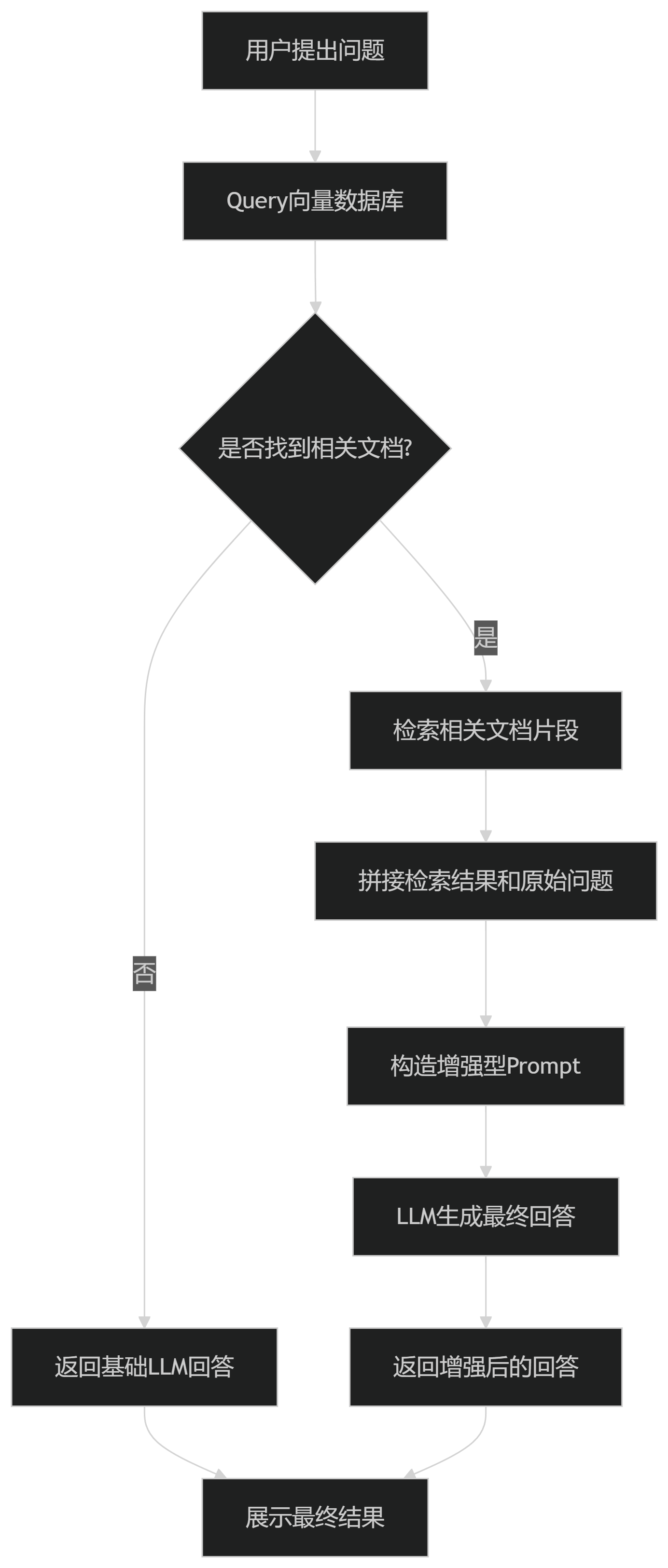

(流程图来袭👇)

流程图说明:

- 用户提出问题作为流程起点

- 系统首先查询向量数据库检索相关知识

- 根据检索结果判断是否找到相关文档

- 如果找到相关文档,拼接问题与检索结果构造增强型prompt

- 将增强后的prompt输入LLM生成最终回答

- 若未找到相关文档,则直接使用基础LLM能力回答

- 最终统一返回结果给用户

RAG的四大必杀技

- 准确性开挂:答案自带文献支撑,拒绝"我觉得..."式瞎猜

- 实时更新:知识库更新=模型秒懂新知识,不用重新训练

- 可解释性强:生成答案时标注参考来源,像写论文加脚注

- 适用性广:可以应用于多个领域。

应用场景脑洞

- 客服系统:秒查产品手册生成专业回答

- 医疗助手:结合最新论文给出诊断建议

- 企业知识库:让新员工秒变老油条

技术人的冷笑话时间

问:为什么RAG比传统模型更受老板喜欢?

答:因为它真的会"查(文献)水表"啊!( ̄▽ ̄)~*

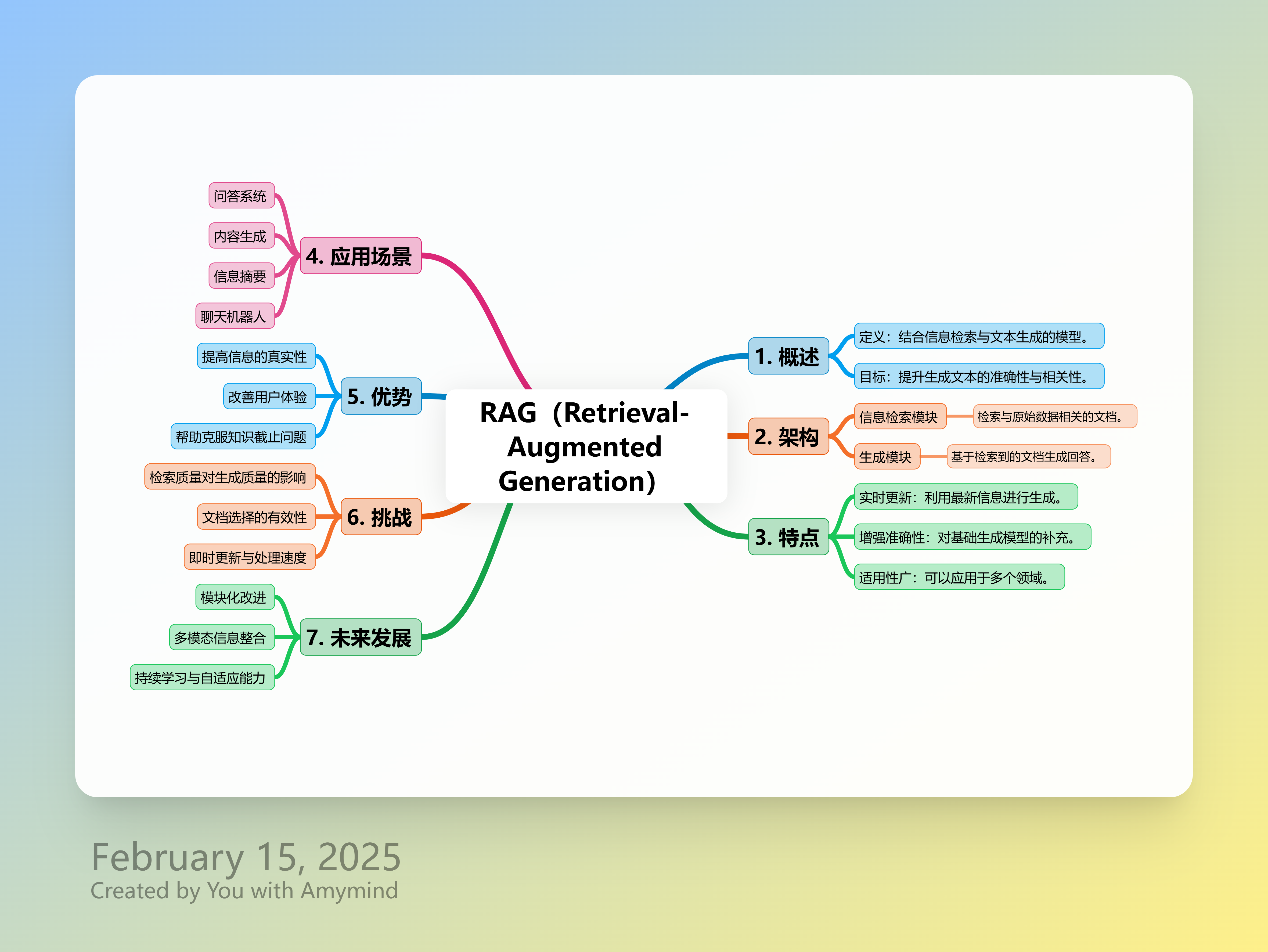

思维导图

为了方便大家记忆,特意制作了思维导图,大家可以看看:

总结

RAG正在重塑AI的知识边界,让机器不仅会创作,更懂得"引经据典"。

重磅福利!

每次看到后台「已读完80%」的提示,就知道又是你们这群小机灵鬼在等彩蛋啦~这次准备了够分量的惊喜,就当是我们之间的专属暗号咯❤️。

(悄悄说:中奖率高达1/3,读完就有机会白嫖)

🔥 只需3步薅羊毛:

✅ STEP 1:猛戳顶部蓝字「枫夜之求索阁」一键跳转

(就像双击好友头像那样简单)

✅ STEP 2:在对话框粘贴神秘代码 → 【deepseek】

(每日暗号彩蛋:其实这是我最爱的AI工具)

✅ STEP 3:猛戳弹出的传送门 → 抢红包啦!

⏳ 倒计时警报:只剩最后72小时解锁彩蛋

(2月18日14:00准时关闭传送通道)

🎯下期带大家手把手实现简易版RAG系统,关注我,技术不迷路!